投資正在遠離大模型

【摘要】投資人有的不喜歡價格戰,有的覺得大模型太耗能

最近一段時間,大模型圈子里很是熱鬧。

先是5月中旬字節發布自家大模型產品,定價比市場價便宜99.3%,隨后阿里、騰訊、科大訊飛等十幾家大模型廠商也紛紛宣布下調旗下大模型產品定價,甚至有廠商直接宣布完全免費開放......在AI大模型愈發同質化的當下,價格似乎成為AI企業們唯一的競爭手段。

百川智能的CEO王小川最近就在他的自媒體賬號上表態:

開發一個大模型,研發、人員、算力成本都很高,如果不賺用戶的錢,那么就要賺投資人的錢。

人工智能領域投資降溫

5月27日,市場研究機構PitchBook發布了2024年Q1全球人工智能(AI)與機器學習領域的最新投融資數據報告。

根據報告顯示,2024年第一季度(1-3月),全球AI領域共計完成1779筆融資交易,融資金額約為1564.27億元人民幣,這個數字環比下降了7.8%,同比下降了31.2%。

圖源:PitchBook

從PitchBook發布的報告圖表來看,實際上從2022年開始,全球AI領域的融資交易筆數和金額就開始“縮水”了。

炒作之后,市場逐步回歸理性是一個正常的現象,從去年開始我們就很少看大模型領域的投資機會,很多圈內的朋友也對AI大模型領域的興趣減弱。

國壽資產研究員劉康對財經光年表示,人工智能產業長期增長潛力仍然巨大,但高昂的成本和充滿不確定的預期給投資人們設下了“減速帶”。

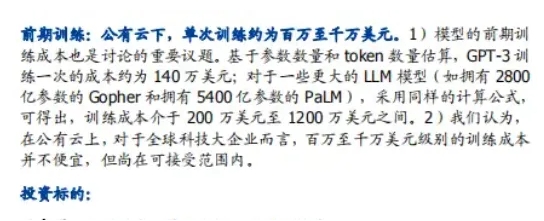

圖源:國盛證券研報

事實上,這部分資金僅是前期投入,算上大模型上線后每日的運營和電費成本,整個投入會更加夸張。

高昂的成本之下,部分大模型上市公司也陷入了“虧損魔咒”。

曾經的大模型明星公司第四范式(06682.HK)已經連續虧損4年,其每年大模型研發投入成本均占營業收入50%左右;手握天工大模型的昆侖萬維(300418.SZ),在近期公布的一季度凈利潤下滑近200%,首次出現虧損情況。

人工智能拉響ESG警報

除了最直接的成本和預期問題的影響之外,開發AI大模型背后帶來的能源消耗問題,同樣成為許多偏好ESG的投資人遠離AI的關鍵誘因。

大量的AI大模型如雨后春筍般出現,帶來極大的能源消耗。同時,大多數AI企業模式很難具備長期可持續性,這違背了ESG投資的初衷。

一位ESG投資經理向財經光年透露,和可持續發展聯盟、綠色金融研究院等組織呼吁ESG投資機構減少投資AI大模型領域的觀點如出一轍。

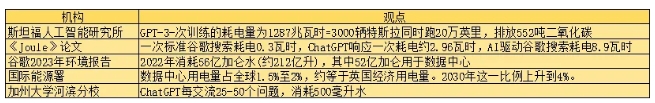

那么AI到底有多耗能?

斯坦福人工智能研究所發布的《2023年AI指數報告》就整體研究了GPT-3的耗電量,當前AI大語言模型GPT-3的一次訓練耗電量高達1287兆瓦時,相當于3000輛特斯拉電動汽車連續行駛20萬英里所消耗的電能總和。同時,這樣的訓練過程還伴隨著552噸二氧化碳的排放。

與此同時,水資源在AI大模型訓練中同樣扮演著重要角色。根據加州大學河濱分校教授任紹磊的一項研究,GPT-3在訓練期間耗水近700噸,這意味著每回答20到50個問題,就需消耗500毫升水。這部分水資源主要用于冷卻設備,以維持服務器的高效運行。

近期AI能耗資訊整理

隨著技術的進步,更強大的AI模型相繼問世。據悉,GPT-4的主要參數是GPT-3的20倍,計算量更是達到了GPT-3的10倍,這意味著其能耗也將急速攀升。

華泰證券曾在研報中預測,到2030年,中國與美國的數據中心總用電量將分別激增至0.65萬億千瓦時至0.95萬億千瓦時、1.2萬億千瓦時至1.7萬億千瓦時,相較于2022年分別增長3.5倍和6倍以上。屆時,AI用電量將占據全社會用電量的顯著份額,預計在中國和美國將分別達到20%和31%。

英偉達CEO黃仁勛就曾公開表示:

AI 實際上幫助人們節省能源。如果不是因為你創建的 AI 模型,如果沒有AI,我們怎么能節省6倍或10倍的成本呢?一旦模型訓練一次,數百萬工程師將會從中受益,幾十年來數十億人將會享受到節省的成本。

縱使當前人工智能行業具有較高的資源消耗、社會管制、隱私泄露等風險,但AI廣泛應用于醫療、交通、制造業等領域,各行業借此實現效率提升,同樣能推動綠色低碳發展。

劉康表示:

耗能大也好,投融資緊縮也好,這個事本質上還是因為現在大模型太多了,那么多大模型卻沒有相應的需求,這才顯得能源被過度消耗,而這也恰恰是行業發展的必經之路,市場經過淘汰后,資源才會向頭部集中。

財經光年